4. Sprechen mit elektronischen Geräten: Rozdźěl mjez wersijomaj

| (Jedna mjezywersija wot samsneho wužiwarja njepokazana) | |||

| Rjadka 171: | Rjadka 171: | ||

==== Baustein 1: Spracherkennung (Automatic Speech Recognition, ASR; Speech to Text, STT) ==== | ==== Baustein 1: Spracherkennung (Automatic Speech Recognition, ASR; Speech to Text, STT) ==== | ||

* sorbische Ausgangslage: Vorarbeiten | * sorbische Ausgangslage: die folgenden Vorarbeiten sind vorhanden | ||

* '''Mozilla common voice''': | * '''Mozilla common voice''': | ||

** die sorbischen Sprachen werden hier aktuell nicht weiter ergänzt, die gesammelten Daten werden jedoch in anderen Projekten weiter verwendet | ** die sorbischen Sprachen werden hier aktuell nicht weiter ergänzt, die gesammelten Daten werden jedoch in anderen Projekten weiter verwendet | ||

| Rjadka 179: | Rjadka 179: | ||

** diese sind aktuell in sehr unterschiedlicher Qualität, sehr unausgewogen hinsichtlich der Stimmen (Geschlecht- und Alter-Verteilung) | ** diese sind aktuell in sehr unterschiedlicher Qualität, sehr unausgewogen hinsichtlich der Stimmen (Geschlecht- und Alter-Verteilung) | ||

** darüber hinaus lassen sich die Sätze common voice aktuell nicht thematisch zuordnen | ** darüber hinaus lassen sich die Sätze common voice aktuell nicht thematisch zuordnen | ||

** Für das Niedersorbische fehlen die Sätze und das Einsprechen<ref name="ftn17">vgl. [https://voice.mozilla.org/de/languages https://voice.mozilla.org/de/languages]</ref> | ** Für das Niedersorbische fehlen die Sätze und das Einsprechen<ref name="ftn17">vgl. [https://voice.mozilla.org/de/languages https://voice.mozilla.org/de/languages]</ref> <br> | ||

* '''Prototyp "smart lamp" / "digidom"''' | * '''Prototyp "smart lamp" / "digidom"''' | ||

** 2020 startete das '''Projekt „Spracherkennung und maschinelle Übersetzung der sorbischen Sprachen'''“ der Stiftung für das sorbische Volk | ** 2020 startete das '''Projekt „Spracherkennung und maschinelle Übersetzung der sorbischen Sprachen'''“ der Stiftung für das sorbische Volk | ||

| Rjadka 195: | Rjadka 195: | ||

*** Prototyp „digidom“ unter Open Source Lizenz veröffentlicht <ref>vgl. [https://github.com/ZalozbaDev/raspberry_pi_demo_spoznawanje https://github.com/ZalozbaDev/raspberry_pi_demo_spoznawanje]</ref> | *** Prototyp „digidom“ unter Open Source Lizenz veröffentlicht <ref>vgl. [https://github.com/ZalozbaDev/raspberry_pi_demo_spoznawanje https://github.com/ZalozbaDev/raspberry_pi_demo_spoznawanje]</ref> | ||

*** Veröfentlichung der Ergebnisse in einer Studie<ref>vgl. [http://www.essv.de/pdf/2021_43_50.pdf http://www.essv.de/pdf/2021_43_50.pdf]</ref> | *** Veröfentlichung der Ergebnisse in einer Studie<ref>vgl. [http://www.essv.de/pdf/2021_43_50.pdf http://www.essv.de/pdf/2021_43_50.pdf]</ref> | ||

*** Veröffentlichen von Kriterien zur Auswahl eines Sprachkorpus<ref>vgl. [https://github.com/ZalozbaDev/speech_recognition_corpus_creation/blob/main/report/report_summary_german.pdf https://github.com/ZalozbaDev/speech_recognition_corpus_creation/blob/main/report/report_summary_german.pdf]</ref> | *** Veröffentlichen von Kriterien zur Auswahl eines Sprachkorpus<ref>vgl. [https://github.com/ZalozbaDev/speech_recognition_corpus_creation/blob/main/report/report_summary_german.pdf https://github.com/ZalozbaDev/speech_recognition_corpus_creation/blob/main/report/report_summary_german.pdf]</ref> <br> | ||

* | |||

* '''Folgeprojekt "Vorbereitung der Spracherkennung für das Obersorbische für eine Diktierfunktion"''' 2023: | |||

** Das Ziel war die Entwicklung neuer und Verbesserung bestehender akustischer Modelle für die obersorbische Spracherkennung. | |||

** Hierfür sollten akustische Modelle auf größeren Audiokorpora trainiert werden. | |||

*** Es erfolgte eine Erweiterung der Sprachdatensätze mittels Augmentation, d. h. Einfügen von Hintergrundgeräuschen verschiedener Stärke. | |||

*** Monophon- und Triphon-basierte Modelle wurden mit dem Open-Source-ASR-Toolkit KALDI trainiert. | |||

*** Die Daten für die Modelle stammen aus verschiedenen Quellen, einschließlich des Common Voice Projekts, der ersten Machbarkeitsstudie (HSB-I) und neuen Audiodaten aus dem aktuellen Projekt. | |||

*** Nach der Datenaugmentation umfassten die Sprachaufnahmen insgesamt 33:31:10 Stunden und 29.229 gesprochene Sätze. | |||

** Triphon-basierte Modelle zeigten eine signifikant bessere Leistung als das monophon-basierte Modell. | |||

** Ein robusteres und weiterentwickeltes triphon-basiertes akustisches Modell wurde erfolgreich erstellt. | |||

** Mit den folgenden Schritten erfolgte die Verbesserung der Sprachmodellierung mit den bereitgestellten Ressourcen: | |||

*** Vorverarbeitung und Normalisierung der Textdaten, z. B. Erkennen von Abkürzungen und Eigennamen, Segmentierung von Wörtern in morphologische Einheiten usw. | |||

*** Wortklassenmodellierung durch Erkennung benannter Einheiten aus vordefinierten Wortklassen, z. B. Datums-, Uhrzeits-, Wochentags-, Namens-, Orts- und Zahlen-Ausdrücke. | |||

*** Teilwortzerlegung mittels Byte Pair Encoding (BPE) und dem Morfessor-Algorithmus, um das Vokabular zu verkleinern. | |||

** Die Wahl des richtigen Teilwortzerlegungsverfahrens und der geeigneten Vokabulargröße hat einen signifikanten Einfluss auf die Leistung des Sprachmodells. | |||

** Im Ergebnis konnte eine Sammlung von normalisierten Textkorpora erzeugt werden, der für das Training von statistischen Sprachmodellen basierend auf ganzen Wörtern oder Wortteilen geeignet ist. | |||

* Weitere Arbeit an Robustheit und Leistungsfähigkeit von "digidom" ist nötig <br> | |||

* '''weitere Applikationen mittels Spracherkennung''' | * '''weitere Applikationen mittels Spracherkennung''' | ||

Aktualna wersija wot 6. julija 2023, 14:15

Einleitung

Dieser Themenbereich beinhaltet die Unterstützung des Anwenders beim Sprechen mit elektronischen Geräten in den sorbischen Sprachen. Im Fokus steht die Interaktion von Menschen mit elektronischen Geräten mittels gesprochener Worte. Dies umfasst folgende Bereiche:

- Sprachausgabe: das Vorlesen geschriebener sorbischer Wörter

- Spracherkennung: das Erkennen und Darstellen von gesprochenen sorbischen Wörtern durch elektronische Geräte (Computer, Smartphones usw.)

- Sprachverarbeitung: das Verarbeiten gesprochener sorbischer Wörter und Reagieren darauf (z. B. Anweisungen ausführen, Antworten).

Mögliche Einsatzbereiche und Applikationen sind bspw.

- Sprachassistenten,

- Spiele, Spielzeuge (wie Lingufino),

- Untertitel und Simultanübersetzungen (z. B. bei Videokonferenzen).

Visionen und Ziel für die sorbische digitale Welt

Vision 2028

Konkrete Visionen 2025

Konkrete Ziele

Einzelne Applikationen verstehen die gesprochenen sorbischen Sprachen und stellen gesprochene Worte dar. (Spracherkennung)

Einzelne Applikationen können sorbische Worte vorlesen. (Sprachausgabe)

Einzelne Applikationen können gesprochene sorbische Worte und Sätze erkennen, verarbeiten und ausgeben, z. B. in einem Online-Videokonferenzsystem mit Simultanübersetzung als Untertitel.

|

Ist-Analyse Stand der Entwicklung von Sprachassistenzsystemen

Welche Bausteine werden für eine Sprachassistenz benötigt?

Um eine sprachliche Interaktion mit einem elektronischen Gerät ähnlich wie mit Menschen zu erreichen, sind verschiedene technische Bausteine notwendig, welche jeweils unterschiedliche Aufgaben übernehmen. Die folgende Einteilung der Bausteine orientiert sich an einem Vortrag von Jan Budar vom 13.09.2018 in Senftenberg zu “Digitalisierung als Chance für die Sorben”.

Baustein 1: Spracherkennung (Automatic Speech Recognition, ASR; Speech to Text, STT)[1]

- basiert auf phonetischen Informationen zu

- einzelnen Buchstaben und Silben

- deren Kombinationen

- ihrer Position im Wort/Satz

Umwandlung von gesprochener Sprache in Text

Die typischen Schritte zur Umwandlung von gesprochener Sprache in Text (Speech-to-Text, STT) sind:

- Aufnahme der Sprache: Der erste Schritt besteht darin, die gesprochene Sprache aufzunehmen. Dies kann entweder über ein Mikrofon oder eine andere Audioquelle erfolgen.

- Signalverarbeitung: Die aufgenommenen Audiosignale werden durch Signalverarbeitungsalgorithmen vorverarbeitet. Dazu gehören zum Beispiel Rauschunterdrückung, Echo-Entfernung und Entzerrung.

- Sprachsegmentierung: Die Audioaufnahme wird in kurze Segmente unterteilt, die normalerweise zwischen 10 und 30 Millisekunden lang sind. Diese Segmente werden dann weiterverarbeitet.

- Merkmalsextraktion: Für jedes Sprachsegment werden akustische Merkmale wie Frequenz, Lautstärke, Tonhöhe und Dauer extrahiert. Diese Merkmale dienen als Eingabe für das Spracherkennungsmodell.

- Spracherkennung: Das Spracherkennungsmodell verwendet die extrahierten Merkmale, um die gesprochene Sprache in Text umzuwandeln. Dieser Schritt kann auf unterschiedliche Weise durchgeführt werden, z.B. mit Hidden Markov Models (HMMs), künstlichen neuronalen Netzen (KNNs) oder Deep-Learning-Modellen.

- Postprocessing: Der erkannte Text wird postprozessiert, um mögliche Fehler oder Inkonsistenzen im Text zu korrigieren. Dazu können beispielsweise Grammatik- und Sprachmodelle verwendet werden, um den erkannten Text zu verbessern.

- Textausgabe: Der endgültige Text wird dann ausgegeben, z.B. in einer Textdatei oder als Eingabe für eine andere Anwendung.

Je nach Anwendung und Sprachmodell können die genauen Schritte und Technologien zur Umwandlung von Sprache in Text variieren.

Training von Spracherkennungs-Maschinen

- vgl. auch Vortrag von D. Sobe 2022 im Rahmen einer Online-Abendveranstaltung[2]

Klassischerweise wird die Spracherkennung durch die Verwendung von stochastische Modellen wie Hidden-Markov-Modellen (HMM) und Gauss'schen Mischmodellen (GMM) durchgeführt. Das Sprachsignal wird dabei in kurze Abschnitte, sogenannte Phoneme, unterteilt. Die Phoneme werden dann in einer HMM- oder GMM-Datenbank gespeichert. Bei der Erkennung wird das Sprachsignal in Phoneme aufgeteilt und mit der HMM- oder GMM-Datenbank abgeglichen, um die wahrscheinlichste Sequenz von Phonemen zu finden. Diese wird dann in Text umgewandelt und ausgegeben.

In den letzten Jahren haben sich Deep Learning Modelle mit tiefen neuronalen Netzen, wie z.B. Recurrent Neural Networks (RNNs) und Convolutional Neural Networks (CNNs), als effektive Methoden zur Spracherkennung erwiesen. Diese Modelle können komplexe Beziehungen zwischen Phonemen und Wörtern erfassen und somit die Genauigkeit der Spracherkennung verbessern.

- z. B. Mozilla Common Voice[3] in Kombination mit einer Spracherkennungs-Engine wie Mozilla Deep Speech

Erstellung von Spracherkennungs-Maschinen

Um eine Spracherkennungs-Engine (Speech-to-Text) zu erstellen, werden verschiedene Ressourcen benötigt, darunter:

- Sprachdaten: Um ein Spracherkennungsmodell zu trainieren, werden große Mengen an Audioaufnahmen benötigt, die repräsentativ für die Sprache und den Dialekt sind, den die Engine erkennen soll. Diese Sprachdaten sollten auch verschiedene Sprecher, Akzente und Hintergrundgeräusche enthalten.

- Transkriptionen: Jede Audioaufnahme muss mit einer Texttranskription versehen werden, die angibt, was in der Aufnahme gesagt wird. Diese Transkriptionen werden verwendet, um das Modell zu trainieren und zu testen.

- Sprachmodelle: Sprachmodelle sind eine wichtige Komponente von Spracherkennungs-Engines, da sie die Wahrscheinlichkeit berechnen, mit der eine bestimmte Sequenz von Wörtern in einem bestimmten Kontext auftreten wird. Diese Modelle werden verwendet, um die Wahrscheinlichkeit des erkannten Textes zu berechnen und die Genauigkeit der Spracherkennungs-Engine zu verbessern.

- Aussprachelexika: Ein Aussprachelexikon enthält eine Liste von Wörtern und deren Aussprache in der jeweiligen Sprache. Dies wird verwendet, um die richtige Aussprache von Wörtern im erkannten Text zu bestimmen.

- Phonemmodelle: Phonemmodelle beschreiben, wie Wörter in ihre kleinsten sprachlichen Einheiten (Phoneme) aufgeteilt werden können. Diese Modelle werden verwendet, um die Wahrscheinlichkeit von Phonemsequenzen zu berechnen und die Genauigkeit der Spracherkennungs-Engine zu verbessern.

- Linguistische Ressourcen: Zusätzlich zu den oben genannten Ressourcen können auch linguistische Ressourcen wie Grammatiken, semantische Modelle und syntaktische Modelle verwendet werden, um die Genauigkeit der Spracherkennungs-Engine zu verbessern.

Baustein 2: Textübersetzung (Machine Translation, MT)

- Grundlage hierfür sind Massen an übersetzten Sätzen

- Künstliche Intelligenz lernt aus diesen übersetzten Sätzen durch

- Mustererkennung

- Training

- vgl. Kapitel 5 Abschnitt Übersetzer

Baustein 3: Intention erkennen und Anweisungen ausführen[4]

- aus dem erkannten Text wird die Intention des Nutzers extrahiert (intent parser)

- Anweisungen werden abgeleitet und ausgeführt (Skill invocation)

- z. B. https://wit.ai/ (eine Sprachplattform, welche zum Facebook-Konzern gehört)

- z.B. https://mycroft.ai/als datenschutzfreundliche Alternative

Baustein 4: Sprachausgabe (Text to Speech, TTS)[5]

- bspw. für barrierefreie Webseiten notwendig

- Open Source Text-to-speech-System: MaryTTS

- modularer Aufbau: Lexikon, Sprache, Daten, Synthese

- Unit-Selectin-Synthese (Verkettung natürlichsprachlicher Elemente)

- ThorstenVoice (OSS Variante)

Die folgenden Schritte sind typischerweise erforderlich, um einen Text in eine gesprochene Sprachausgabe umzuwandeln:

- Linguistische Analyse: Der eingegebene Text wird vorverarbeitet, um dessen Struktur zu analysieren, einschließlich der Trennung von Sätzen, der Erkennung von Interpunktion und der Ermittlung der Betonung.

- Phonetische Umsetzung: Der Text wird in eine phonetische Darstellung umgewandelt, in der jeder Textabschnitt in eine entsprechende Sequenz von Lauten (Phonemen) übersetzt wird. Dies wird typischerweise durch eine phonetische Lexikon-Datenbank und Sprachregeln erreicht.

- Prosodische Modellierung: Es wird die Betonung und Intonation des Textes bestimmt. Hierbei werden Faktoren wie Akzent, Tonhöhe, Tempo, Pause und Rhythmus berücksichtigt, um eine natürliche Sprachmelodie zu erzeugen.

- Synthese: Der phonetisch umgesetzte Text wird dann in Sprache umgewandelt, indem die phonetischen Einheiten zu Sprachsignalen zusammengefügt werden. Dies kann entweder durch die Verwendung von Klangeinheiten, die in einer Datenbank gespeichert sind, oder durch das Generieren von Sprache auf der Grundlage von Modellen, wie z.B. Deep-Learning-Modellen, erfolgen.

Eine TTS-Engine benötigt folgende Voraussetzungen:

- Eine umfangreiche phonetische Datenbank oder ein phonetisches Modell, um die Übersetzung von Text in Phoneme zu ermöglichen.

- Ein Prosodie-Modell, um die natürliche Sprachmelodie zu erzeugen.

- Eine Sprachsynthesetechnologie, um die Phoneme in Sprachsignale zu konvertieren.

- Training mit großen Datenmengen, um die Sprachsynthese-Modelle auf die spezifische Sprache und Stimme zu optimieren.

Definition und Marktübersicht von Sprachassistenten

Ein Sprachassistent ist eine bestimmte Art von Software, die gesprochene Worte analysiert, in den richtigen Kontext einordnet und darauf reagiert. Sprachassistenten sind als Software meist in Smartphones oder Smart Speaker, aber auch in Konsolen (PS4), Fernseher und smart watches integriert. Ein Smart Speaker wiederum ist ein bestimmtes Gerät, auf welchem der Sprachassistent als Software installiert ist.[6] Spricht ein Mensch mit diesem Gerät, so beantwortet es über seine Sprachsoftware verbal Fragen oder führt Anweisungen aus, z. B. steuert es vernetzte smart home Geräte (TV-Geräte, Heizungsthermostate, Rollläden, Lampen, Waschmaschine, Backofen, Kaffeemaschine bis hin zur Toilettenspülung usw.). Auch in Autos, Kopfhörern, Bürogeräten und Kleidung sind bereits Sprachassistenten im Einsatz.

Die Entwicklung der Sprachassistenten:* 2010 Apples Siri („Hey Siri“)

- 2012 Google Assistant (vormals Google Now) („Ok, Google“)

- 2013 Microsoft Cortana („Hey Cortana“)

- 2014 Amazon Alexa („Alexa“)

- 2015 Mycroft - open Source Smart Speaker (“Hey Mycroft”)[7]

- 2017 Sprachassistenten der chinesischen Firmen Baidu und Alibaba

- 2018 Samsung Bixby („Hi Bixby“)

- 2019 Leon – open source personal assistant[8]

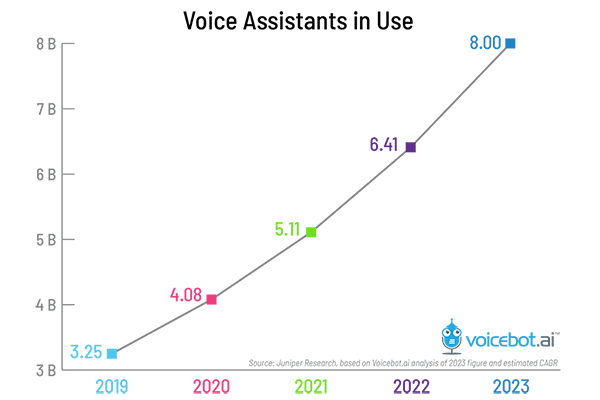

Heute sind weltweit bereits mehr als 4 Milliarden Sprachassistenten im Einsatz. Bis 2023 rechnet die Marktforschungsfirma Juniper Research mit 8 Milliarden Sprachassistenten.[9]

Marktübersicht

Die führenden Anbieter für Sprachassistenzsysteme am weltweiten Markt sind:

- Amazon mit seinem Sprachassistenzsystem "Alexa" und den Amazon Echo Geräten.

- Google mit seinem Sprachassistenzsystem "Google Assistant" und den Google Home Geräten.

- Apple mit seinem Sprachassistenzsystem "Siri" und der HomePod-Produktlinie.

- Microsoft mit seinem Sprachassistenzsystem "Cortana" und der Surface Headphones Produktlinie.

- Samsung mit seinem Sprachassistenzsystem "Bixby" und der Galaxy Home Produktlinie.

Diese Anbieter haben in den letzten Jahren in die Entwicklung und Verbesserung von Sprachassistenzsystemen investiert und setzen auf künstliche Intelligenz und maschinelles Lernen, um die Spracherkennung und -verarbeitung zu verbessern. Dabei sind ihre Sprachassistenzsysteme nicht nur auf den Heimgebrauch beschränkt, sondern auch in mobilen Geräten, Autos und anderen Branchen wie Gesundheitswesen, Einzelhandel und Finanzen verbreitet.

Es ist schwierig, genaue Zahlen darüber zu finden, welchen Anteil jeder Anbieter am Gesamtmarkt für Sprachassistenzsysteme hat, da es keine einheitliche Definition des Marktes gibt und die Zahlen von verschiedenen Marktforschungsunternehmen variieren können. Basierend auf den verfügbaren Daten sind die größten Anbieter am Markt Amazon Alexa mit rund 25% Marktanteil, Google Assistant mit rund 20% Marktanteil und Apples Siri mit rund 15% Marktanteil weltweit. Es gibt jedoch Unterschiede in den Zahlen je nach Region und Art des Geräts (z.B. intelligente Lautsprecher, Mobiltelefone, Smart-Home-Geräte).

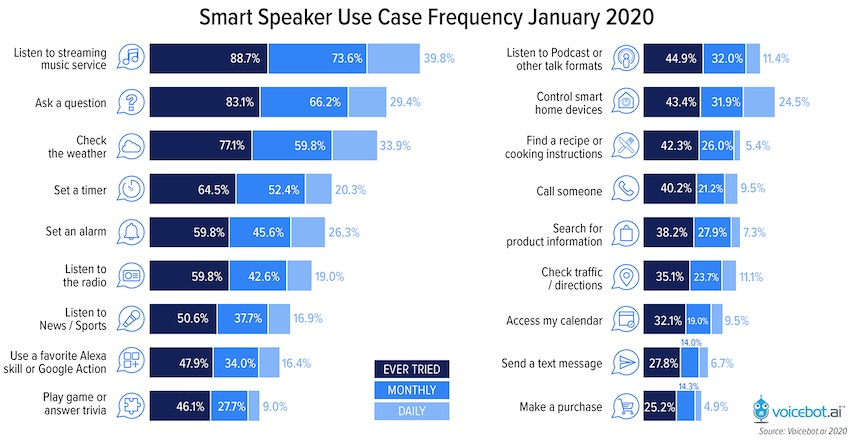

Die beliebtesten Anwendungsfälle von Nutzern von Smart Speakern sind[10]

- Musik hören

- Fragen stellen

- Wetter checken

- Zeitschaltuhr einschalten

- Alarm einstellen

- Radio hören

Aktuell unterstützte Sprachen[11]

- Amazons Alexa unterstützt 9 Sprachen

- Arabisch, Deutsch, Englisch (5 Dialekte), Französisch (2 Dialekte), Hindi (Indisch), Italienisch, Japanisch, Portugiesisch (Brasil.), Spanisch (3 Dialekte)

- Google Assistant unterstützt 44 Sprachen auf Smartphones

- Google Assistant unterstützt 13 Sprachen auf Smart Speakern / Google Home

- Dänisch, Deutsch (2 Dialekte), Englisch (6 Dialekte), Französisch (2 Dialekte), Hindi, Italienisch, Japanisch, Koreanisch, Niederländisch, Norwegisch, Portugiesisch (Brasil.), Schwedisch, Spanisch (3 Dialekte)

- Apples Siri unterstützt rund 42 Sprachen

Ist-Analyse sorbischer Potenziale, Ressourcen und Projekte

Während digitale Angebote wie Sprachausgabe und Spracherkennung in deutscher Sprache selbstverständlich sind und sowohl von internationalen Großkonzernen als auch von der öffentlichen Hand vorangetrieben und ausgebaut werden, gilt das für dieselben Angebote in sorbischer Sprache nur sehr eingeschränkt. Welche Grundlagen der Sprachunterstützung beider sorbischer Sprachen bereits realisiert oder geplant sind, sollen die folgenden Abschnitte untersuchen.

Ist-Stand der 4 Bausteine des Sprechens mit elektronischen Geräten

Baustein 1: Spracherkennung (Automatic Speech Recognition, ASR; Speech to Text, STT)

- sorbische Ausgangslage: die folgenden Vorarbeiten sind vorhanden

- Mozilla common voice:

- die sorbischen Sprachen werden hier aktuell nicht weiter ergänzt, die gesammelten Daten werden jedoch in anderen Projekten weiter verwendet

- die Anzahl an Daten ist bei weitem nicht ausreichend für den Einsatz von neuronalen Technologien

- die Qualität der Daten ist nur hinreichend für die Evaluation von Spracherkennungssystemen, nicht jedoch für deren Training (hierfür wird Tonstudio-Qualität benötigt)

- für das Obersorbische wurden bereits ca. 7.500 lizenzfreie Sätze gesammelt sowie 2 Stunden und 51 Minuten eingesprochen und validiert

- diese sind aktuell in sehr unterschiedlicher Qualität, sehr unausgewogen hinsichtlich der Stimmen (Geschlecht- und Alter-Verteilung)

- darüber hinaus lassen sich die Sätze common voice aktuell nicht thematisch zuordnen

- Für das Niedersorbische fehlen die Sätze und das Einsprechen[12]

- die sorbischen Sprachen werden hier aktuell nicht weiter ergänzt, die gesammelten Daten werden jedoch in anderen Projekten weiter verwendet

- Prototyp "smart lamp" / "digidom"

- 2020 startete das Projekt „Spracherkennung und maschinelle Übersetzung der sorbischen Sprachen“ der Stiftung für das sorbische Volk

- Durchgeführt wurde eine Machbarkeitsstudie zur automatischen Spracherkennung für die obersorbische Sprache vom Fraunhofer-Institut für keramische Technologien und Systeme Dresden (Abteilung Maschinelles Lernen und Datenanalyse) in Zusammenarbeit mit der Brandenburgischen Technischen Universität Cottbus mit folgenden Zielstellungen:

- Realisierung eines prototypischen Spracherkenners für eine spezifizierte Beispielanwendung in einer stark beschränkten Sprachdomäne

- Ziel wurde es, eine Smart-Home-Anwendung zu erstellen, welches mittels Sprachbefehlen eine Lampe bedienen kann, "digidom"

- Einschätzung möglicher und empfohlener Technologien für die Entwicklung eines sorbischen Spracherkenners mit umfangreichem Wortschatz

- Aussagen zur Anwendung der niedersorbischen Sprache

- Folgende Arbeitsschritte wurden bisher für dieses Projekt durchgeführt:

- Statistische Auswertung von Textkorpora

- Aufstellen der Phonemliste und der Ausspracheregeln

- Auswahl an Aufzeichnungen aus „Common Voice“ sowie neue Aufzeichnungen wurden erstellt

- Demonstrator unter Open Source Lizenz veröffentlicht[13]

- Prototyp „digidom“ unter Open Source Lizenz veröffentlicht [14]

- Veröfentlichung der Ergebnisse in einer Studie[15]

- Veröffentlichen von Kriterien zur Auswahl eines Sprachkorpus[16]

- Folgeprojekt "Vorbereitung der Spracherkennung für das Obersorbische für eine Diktierfunktion" 2023:

- Das Ziel war die Entwicklung neuer und Verbesserung bestehender akustischer Modelle für die obersorbische Spracherkennung.

- Hierfür sollten akustische Modelle auf größeren Audiokorpora trainiert werden.

- Es erfolgte eine Erweiterung der Sprachdatensätze mittels Augmentation, d. h. Einfügen von Hintergrundgeräuschen verschiedener Stärke.

- Monophon- und Triphon-basierte Modelle wurden mit dem Open-Source-ASR-Toolkit KALDI trainiert.

- Die Daten für die Modelle stammen aus verschiedenen Quellen, einschließlich des Common Voice Projekts, der ersten Machbarkeitsstudie (HSB-I) und neuen Audiodaten aus dem aktuellen Projekt.

- Nach der Datenaugmentation umfassten die Sprachaufnahmen insgesamt 33:31:10 Stunden und 29.229 gesprochene Sätze.

- Triphon-basierte Modelle zeigten eine signifikant bessere Leistung als das monophon-basierte Modell.

- Ein robusteres und weiterentwickeltes triphon-basiertes akustisches Modell wurde erfolgreich erstellt.

- Mit den folgenden Schritten erfolgte die Verbesserung der Sprachmodellierung mit den bereitgestellten Ressourcen:

- Vorverarbeitung und Normalisierung der Textdaten, z. B. Erkennen von Abkürzungen und Eigennamen, Segmentierung von Wörtern in morphologische Einheiten usw.

- Wortklassenmodellierung durch Erkennung benannter Einheiten aus vordefinierten Wortklassen, z. B. Datums-, Uhrzeits-, Wochentags-, Namens-, Orts- und Zahlen-Ausdrücke.

- Teilwortzerlegung mittels Byte Pair Encoding (BPE) und dem Morfessor-Algorithmus, um das Vokabular zu verkleinern.

- Die Wahl des richtigen Teilwortzerlegungsverfahrens und der geeigneten Vokabulargröße hat einen signifikanten Einfluss auf die Leistung des Sprachmodells.

- Im Ergebnis konnte eine Sammlung von normalisierten Textkorpora erzeugt werden, der für das Training von statistischen Sprachmodellen basierend auf ganzen Wörtern oder Wortteilen geeignet ist.

- Weitere Arbeit an Robustheit und Leistungsfähigkeit von "digidom" ist nötig

- weitere Applikationen mittels Spracherkennung

- Spiele

- Lingufino, eine interaktive Puppe, die auf Spracheingaben reagiert

- Diktierfunktion

- Simultanübersetzung

- Spiele

Baustein 2: Textübersetzung (Machine Translation, MT)

- vgl. auch Kapitel 5 Abschnitt Übersetzer

- Notwendig: umfangreicher 2-sprachiger Textkorpus

- Urheberrechtsfrei, gemeinfrei oder unter Creative-Commons-Lizenz (CC0)

- Satzweise übersetzt

- Vereinheitlicht, maschinenlesbar

- Sorbische Ausgangslage: paralleler Textkorpus liegt im WITAJ-Sprachzentrum vor

- Aufgabe: laufende digitale Erfassung bestehender Übersetzungen in hoher Qualität

- Herausforderung: Technologieneutralität, d. h. eine Textübersetzung unabhängig von einer speziellen Technologie zu erstellen, so dass sie später in verschiedenen Produkten und Diensten genutzt werden kann (Google Translate, Microsoft Bing Translator, DeepL)

- sotra.app: Seit 2019 laufendes Projekt des WITAJ-Sprachzentrums: Aufbau eines automatischen „Online-Übersetzers Deutsch-Sorbisch, Sorbisch-Deutsch“

- seit 2021 verfügbar für Obersorbisch und seit 2022 auch in Niedersorbisch für Texte mit max. 6.000 Zeichen

- Übersetzungen möglich von und nach Deutsch, Ober- und Niedersorbisch und Tschechisch (Beta, von und nach den sorbischen Sprachen)

- zusätzlicher Service: Rechtschreibkontrolle

- Mitte 2022 beinhaltete der 2-sprachige Textkorpus ca. 300.000 parallele Satzpaare

- zukünftig geplant: OCR-Erkennung von Bildern mit Texten

- Historie:

- Aufbau eines großen 2-sprachigen Textkorpus, Ziel bis Ende 2020 ca. 170.000 Satzpaare (ca. 2 Mio. Wörter)

- Ende 2021 beinhaltete der 2-sprachige Textkorpus ca. 260.000 parallele Satzpaare

- das Projekt startete mit dem Tool Microsoft Translator Hub (eingestellt durch Microsoft)

- es wird nun der Ansatz verfolgt, offene Plattformen zu nutzen, um Unabhängigkeit von den Firmen Google, Microsoft, DeepL usw. und deren wirtschaftlichen Interessen zu bewahren

- aktuell wird das statistische System MOSES-decoder genutzt

- parallel erfolgen Tests des neuronalen Systems OpenNMT (Python)

- Microsoft Bing Translator[17]

- Der Bing Translator konnte mittels des 2-sprachigen Teytkorpus des WITAJ-Sprachzentrums auf beide sorbische Sprachen trainiert werden:

- Obersorbisch wird seit 2022 mit aktuell max. 1.000 Zeichen pro Text unterstützt.

- Niedersorbisch wird seit 2023 mit aktuell max. 1.000 Zeichen pro Text unterstützt.

- In der Microsoft Bing Translator App wird lediglich die Funktion 'Text übersetzen' unterstützt. Es fehlen die Funktionen 'Sprechen' (STT), 'autom. Spracherkennung', 'Text in Bild übersetzen', 'Audiowiedergabe der Übersetzung' (TTS), 'Offline übersetzen'.

Baustein 3: Intention erkennen und Anweisungen ausführen

- Hierzu sind keine sorbischen Projekte bekannt. Es kann zu einem späteren Zeitpunkt im Bedarfsfall ggf. auf bereits bestehende Projekte zurückgegriffen werden, wie z. B. https://wit.ai/.

Baustein 4: Sprachausgabe (Text to Speech, TTS)

Erste Projekte in die Richtung Sprachausgabe wurden bereits umgesetzt:

- Audioversion des Deutsch-Niedersorbischen Wörterbuchs (nicht als TTS realisiert)

- Für die niedersorbische Sprache wurden vom Sorbischen Institut seit 2014 Tondateien erstellt und in die online-Fassung des Deutsch-Niedersorbischen Wörterbuchs integriert. In einer wissenschaftlichen Studie wurden zudem die verschiedenen Erfahrungen mit praktischen Schwierigkeiten bei der Aussprache verarbeitet. Diese Studie diente dazu, im Jahre 2018 einen praktischen online-Führer zur Aussprache des Niedersorbischen zu erarbeiten. Hochwertige Tonaufnahmen wurden zusammengestellt und bestimmten Lautgruppen bzw. für den Spracherwerb wichtigen lautlichen Phänomenen zugeordnet, mit wichtigen erläuternden Texten ergänzt und auf www.dolnoserbski.de als neue Dienstleistung angeboten. Dadurch steht erstmals eine praktische, durch Tonbeispiele illustrierte Anleitung zur Aussprache des Niedersorbischen zur Verfügung.

- Entwicklung einer Vorlesefunktion für die nieder- und obersorbische Schriftsprache

- Seit 2018 erfolgen die Konzeption, Planung und Entwicklung einer Vorlesesoftware für Nieder- und Obersorbisch für die Integration in Webseiten, Online-Wörterbücher u. ä. durch das Sorbische Institut in Bautzen. Geplanter Abschluss ist 2023.

- Seit 2023 können die beiden Vorlesestimmen Juro (niedersorbisch) und Matej (obersorbisch) in einer ersten Version ausprobiert werden.[18]

- Bookii-Bücher in sorbischer Sprache[19]

- Aktuell gibt es 9 Bookii-Bücher in obersorbischer Sprache

- und 3 Bookii-Bücher in niedersorbischer Sprache.

- bamborak, TTS-System für Obersorbisch[20]

- Seit 2022 entwickelt K. Baier ein obersorbisches TTS-System auf Basis eines neuronalen Netzes.

- Bisher wurden hierfür ca. 2.400 Sätze aufgenommen und durch das neuronale Netz verarbeitet.

Fazit

Für eine funktionierende Spracherkennung der sorbischen Sprachen ist es noch ein weiter Weg, auf dem die ersten Schritte bereits gegangen wurden. Eine breite Basis an digitalen Wortsammlungen (sog. linguistischen Ressourcen) in Form von Wörterbüchern, Textkorpora sowie entsprechende morphologische Generatoren sind für beide sorbische Sprachen vorhanden, vgl. Kapitel 5. Schreiben auf elektronischen Geräten. Hierfür sind noch die Nutzungsrechte zu klären, vgl. Kapitel 10. Open Access, Open Data, Lizenzen.

Für die hierauf aufbauenden digitalen sorbischen Sprachdienste werden aktuell gerade erst die Grundlagen gelegt oder eruiert. Für die Umsetzung einer Spracherkennung laufen aktuell 2 Projekte: das freiwillige Projekt der Sammlung von Sprachdaten mittels Mozilla common voice sowie das Projekt „Spracherkennung und maschinelle Übersetzung der sorbischen Sprachen“ der Stiftung für das sorbische Volk.

Für die Umsetzung einer automatischen Textübersetzung gibt es das Projekt „Online-Übersetzer Deutsch-Sorbisch, Sorbisch-Deutsch“ des WITAJ-Sprachzentrums. Dieses bezieht sich aktuell zunächst auf obersorbische Texte.

Für den Baustein 3 „Intention erkennen, Anweisungen ausführen“ gibt es keine speziellen sorbischen Projekte, jedoch eine Reihe weltweiter Projekte, einige davon open source. Sind die weiteren Bausteine realisiert, so kann ein passendes System für die Umsetzung dieses Bausteins recherchiert werden.

Für die Sprachausgabe entwickelt das Sorbische Institut bereits eine Vorlesefunktion für beide sorbischen Sprachen, welche voraussichtlich 2023 abgeschlossen ist. Ebenso werden vom Sorbischen Institut die niedersorbischen Online-Wörterbücher nach und nach mit Tonbeispielen unterlegt. Für das Niedersorbische sind hierfür bereits umfangreiche Tonbeispiele zur Aussprache des Niedersorbischen auf www.dolnoserbski.de veröffentlicht.

Übersicht von bisherigen Maßnahmen und Projekten bzgl. Sprachassistenz

Weitere Projekte zu Wörterbüchern u. ä. werden in Abschnitt 5.3.2 "Übersicht von bisherigen Maßnahmen und Projekten bzgl. Schreibunterstützung" genannt.

| Name | Beschreibung | Zeitraum | Verantwortlich |

| Audioversion des Deutsch-Niedersorbischen Wörterbuchs | Tonbeispiele zur Aussprache des Niedersorbischen | Seit 2014 | Sorbisches Institut |

| Erarbeitung eines online-Führers mit Tonbeispielen zur Aussprache des Niedersorbischen | Veröffentlichung auf www.dolnoserbski.de | 2018 | Sorbisches Institut, gefördert durch die Stiftung für das sorbische Volk |

| Entwicklung einer Vorlesefunktion für die nieder- und obersorbische Schriftsprache[21] | Konzeption, Planung und Entwicklung einer Vorlesesoftware für Nieder- und Obersorbisch (geplanter Abschluss 2023) | Seit 2018 | Sorbisches Institut, gefördert durch das Sächsische Staatsministerium für Wissenschaft, Kultur und Tourismus (SMWK) |

| Online-Übersetzer Deutsch-Sorbisch, Sorbisch-Deutsch

(zunächst Obersorbisch) |

Entwicklung und Bereitstellung eines Online-Übersetzungsdienstes für Sätze und Texte, Deutsch-Sorbisch und Sorbisch-Deutsch. Als Übersetzungsgrundlage dient ein bilingualer Textkorpus, welcher erstellt wird und für das Training eines Übersetzungssystems verwendet wird. | Seit 2019 | WITAJ-Sprachzentrum, gefördert durch die Stiftung für das sorbische Volk |

| Mozilla Common Voice obersorbisch und niedersorbisch | Erstellung von öffentlich zugänglichen Sprachdaten, diese stehen via CC0-Lizenz zur freien Nutzung zur Verfügung, z. B. für das Training eine Spracherkennungs-Engine | Seit 2019 | engagierte Privatpersonen |

| Spracherkennung und maschinelle Übersetzung der sorbischen Sprachen | Machbarkeitsstudie zur automatischen Spracherkennung für die obersorbische Sprache, Prototypen "smart lamp" und "digidom" | Seit 2020 | Stiftung für das sorbische Volk |

| Bereitstellung von interaktiven Spielzeugen und Büchern in den sorbischen Sprachen | Bereitstellung von interaktiven Bookii-Büchern und der sprechenden interaktiven Puppe Lingufino in den sorbischen Sprachen | Seit 2018 | Domowina Verlag gGmbH und Medienpädagogisches Projekt LUCIJA des Sorbischen Schulvereins e. V., gefördert durch die Stiftung für das sorbische Volk |

| Bereitstellung von Online-Vorlesefunktionen in obersorbischer Sprache | Vorlesefunktion auf Basis neuronaler Netze für Zahlen und Uhrzeit[22] sowie für Texte[20] | Seit ca. 2020 | eine engagierte Privatperson |

Zukünftige Maßnahmen und Projekte bzgl. Sprachassistenz

Die folgenden Maßnahmen ergeben sich aus der Ist-Analyse. Sie werden in Abschnitt 13.2 beschrieben.

| Sub-Thema | Nr. | Maßnahme | Zielstellung: |

| Spracherkennung | 1.1_1 | Entwicklung einer obersorbischer Spracherkennung (HSB) | Die obersorbische Spracherkennung ist auf den meistgenutzten elektronischen Geräten nutzbar. |

| Spracherkennung | 1.1_2 | Entwicklung einer niedersorbischer Spracherkennung (DSB) | Die niedersorbische Spracherkennung ist auf den meistgenutzten elektronischen Geräten nutzbar. |

| Übersetzungsdienst | 1.1_3 | Entwicklung obersorbischer Übersetzungsdienst (für Sätze) (HSB) | Ein obersorbischer Übersetzungsdienst ist auf den meistgenutzten elektronischen Geräten nutzbar. |

| Übersetzungsdienst | 1.1_4 | Entwicklung niedersorbischer Übersetzungsdienst (für Sätze) (DSB) | Ein niedersorbischer Übersetzungsdienst ist auf den meistgenutzten elektronischen Geräten nutzbar. |

| Sprachausgabe | 1.1_5 und 1.1_6 | Entwicklung einer Sprachausgabe (HSB, DSB) | Eine Sprachausgabe in beiden sorbischen Sprachen ist auf den meistgenutzten elektronischen Geräten nutzbar. |

| Intention und Anweisungen | 1.1_7 | Finden einer Software für 'Intention und Anweisungen' | Für die Interaktion mit elektronischen Geräten kann die gesprochene sorbische Sprache gleichwertig zur geschriebenen Sprache genutzt werden. |

- ↑ Übersicht STT-Engines: https://mycroft-ai.gitbook.io/docs/using-mycroft-ai/customizations/stt-engine

- ↑ vgl. Veranstaltung auf digiserb.de, Folien bei digiserb.de, Video bei YouTube.

- ↑ vgl. https://voice.mozilla.org und https://github.com/mozilla/DeepSpeech

- ↑ vgl. https://mycroft.ai/wp-content/uploads/2018/08/mycroft-ai-introduction-to-voice-stack-whitepaper.pdf

- ↑ Übersicht TTS-Engines: https://mycroft-ai.gitbook.io/docs/using-mycroft-ai/customizations/tts-engine

- ↑ vgl. https://de.wikipedia.org/wiki/Intelligenter_pers%C3%B6nlicher_Assistent

- ↑ vgl. https://mycroft.ai/ und https://www.kickstarter.com/projects/aiforeveryone/mycroft-an-open-source-artificial-intelligence-for/description

- ↑ vgl. https://getleon.ai/

- ↑ vgl. https://voicebot.ai/google-home-google-assistant-stats/#voice-asst-in-use-juniper

- ↑ vgl. https://voicebot.ai/2020/05/03/streaming-music-questions-weather-timers-and-alarms-remain-smart-speaker-killer-apps-third-party-voice-app-usage-not-growing/

- ↑ vgl. https://www.globalme.net/blog/language-support-voice-assistants-compared/ sowie die dort angegeben Webseiten

- ↑ vgl. https://voice.mozilla.org/de/languages

- ↑ vgl. https://github.com/ZalozbaDev/web_demo_spoznawanje

- ↑ vgl. https://github.com/ZalozbaDev/raspberry_pi_demo_spoznawanje

- ↑ vgl. http://www.essv.de/pdf/2021_43_50.pdf

- ↑ vgl. https://github.com/ZalozbaDev/speech_recognition_corpus_creation/blob/main/report/report_summary_german.pdf

- ↑ vgl. https://www.bing.com/translator

- ↑ vgl. http://tts-juro-matej.serbski-institut.de, Projektseite SI, Pressemitteilung SI

- ↑ vgl. https://www.domowina-verlag.de/kinderbuecher/bookii-buecher.html?limit=20

- ↑ 20,0 20,1 vgl. https://gaussia.de/bamborak

- ↑ vgl. https://www.serbski-institut.de/de/Entwicklung-einer-Vorlesefunktion-fuer-die-nieder--und-obersorbische-Schriftsprache/

- ↑ vgl. https://gaussia.de/slp